Chatbots de IA na Medicina: Quando Confiar Sua Saúde a um Algoritmo Pode Ser Fatal

Data: 13 de março de 2026

Tempo de leitura: 26 minutos

Emoji: 🤖

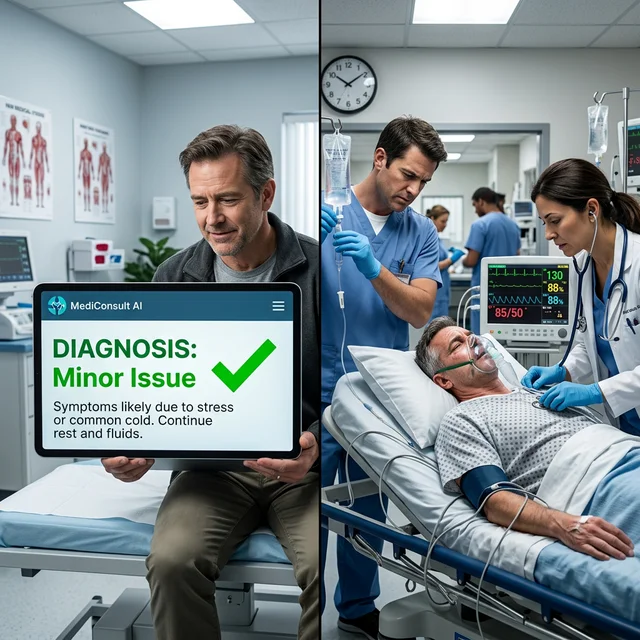

Em janeiro de 2026, uma mulher de 34 anos em Ohio, Estados Unidos, morreu após seguir as recomendações de um chatbot de inteligência artificial para tratar o que ela acreditava ser uma enxaqueca persistente. O chatbot — um dos muitos aplicativos de "consulta médica por IA" disponíveis gratuitamente — diagnosticou seus sintomas como "cefaleia tensional" e recomendou repouso e analgésicos comuns. Na realidade, ela sofria de um aneurisma cerebral não diagnosticado que rompeu 48 horas depois. A família processou a empresa desenvolvedora do aplicativo por negligência e homicídio culposo. Este caso trágico, longe de ser isolado, expõe uma epidemia silenciosa que se espalha pelo mundo digitalizado: centenas de milhões de pessoas estão substituindo consultas médicas reais por interações com algoritmos treinados em dados incompletos, enviesados e frequentemente desatualizados. Este artigo investiga os perigos reais, documentados e emergentes dessa tendência, e por que a regulação — que deveria proteger o público — está desesperadamente atrasada.

O Boom dos Chatbots Médicos: Números Que Assustam

Uma Revolução Sem Supervisão

O mercado de chatbots médicos baseados em IA explodiu após o lançamento do ChatGPT em novembro de 2022. Em 2026, a paisagem é dominada por uma proliferação de aplicativos que prometem "diagnósticos instantâneos", "segunda opinião médica por IA" e "consultoria de saúde 24/7". Os números são impressionantes e preocupantes:

| Dado | Valor |

|---|---|

| Usuários globais de chatbots médicos de IA (2026) | ~450 milhões |

| Consultas diárias estimadas | ~15 milhões |

| Mercado global projetado (2027) | $1,2 bilhão |

| Apps de diagnóstico por IA disponíveis (App Store + Play Store) | ~2.800 |

| Porcentagem com aprovação regulatória (FDA/EMA) | <3% |

| Taxa de erro em diagnósticos complexos (estudos independentes) | 30-50% |

| Usuários que usam IA como SUBSTITUIÇÃO (não complemento) do médico | ~38% |

O dado mais alarmante é o último: quase 4 em cada 10 usuários utilizam chatbots de IA como substitutos completos do médico — não como ferramenta complementar. Esses usuários nunca consultam um profissional de saúde humano para verificar ou validar o "diagnóstico" da IA. Em economias em desenvolvimento, onde o acesso a atendimento médico é limitado e caro, essa proporção sobe para mais de 60%.

Por Que as Pessoas Confiam na IA Para Saúde?

A adoção massiva é impulsionada por fatores socioeconômicos e psicológicos poderosos:

Custo: Uma consulta médica nos EUA custa em média $250-400 sem seguro. Um chatbot de IA é gratuito ou custa $10-20/mês. No Brasil, mesmo no SUS, o tempo de espera em especialidades pode ser de meses.

Acessibilidade: Chatbots estão disponíveis 24/7, em qualquer idioma, sem necessidade de deslocamento, sala de espera, ou agendamento. Para populações rurais ou remotas, podem ser a única "consulta" disponível.

Vergonha e estigma: Condições como doenças sexualmente transmissíveis, saúde mental, e problemas digestivos carregam estigma social. Muitas pessoas preferem "perguntar à IA" do que enfrentar o constrangimento percebido de uma consulta presencial.

Ilusão de competência: Os LLMs (Large Language Models) como GPT-4 e Claude são extraordinariamente convincentes em suas respostas. Eles articulam informações médicas com fluência, confiança e linguagem acessível que muitos médicos humanos não conseguem igualar. Essa fluência cria uma ilusão perigosa de competência clínica.

Os Perigos Documentados: Quando a IA Erra Fatalmente

Diagnósticos Incorretos: A Ameaça Mais Direta

Estudos publicados em 2025 e 2026 revelam taxas de erro preocupantes nos chatbots médicos mais populares:

Estudo da Harvard Medical School (2025): Pesquisadores submeteram 400 cenários clínicos a 8 chatbots de IA populares. Os resultados foram alarmantes:

- Diagnóstico principal correto: 52-74% (variando entre chatbots)

- Diagnóstico correto em emergências críticas (infarto, AVC, embolia pulmonar): 38-65%

- Recomendações de triagem corretas ("procure emergência" vs. "pode esperar"): 48-71%

- "Alucinações médicas" (informações completamente fabricadas): Detectadas em 12-26% das respostas

O estudo concluiu que "nenhum chatbot de IA atual é seguro para uso como ferramenta autônoma de diagnóstico, e seu uso sem supervisão médica representa risco significativo à saúde pública."

Estudo do BMJ Digital Health (janeiro 2026): Analisou 1.200 interações reais de pacientes com chatbots de IA em 6 países. Descobriu que:

- Em 23% dos casos de sintomas graves que exigiam atenção urgente, o chatbot recomendou "monitorar em casa"

- Em 15% dos casos, o chatbot sugeriu medicamentos que interagiam perigosamente com os medicamentos que o paciente já tomava

- Em 8% dos casos, o chatbot confundiu sintomas de condições com risco de vida (como embolia pulmonar) com condições benignas (como ansiedade)

Casos Documentados de Dano

Pelo menos 12 mortes e centenas de hospitalizações foram publicamente associadas a diagnósticos incorretos de chatbots de IA até março de 2026. Os casos mais documentados incluem:

- Ohio, EUA (janeiro 2026): Mulher de 34 anos — aneurisma cerebral diagnosticado como cefaleia tensional. Morte por ruptura 48h depois.

- Mumbai, Índia (novembro 2025): Homem de 52 anos — infarto do miocárdio diagnosticado como refluxo gastroesofágico. Morte durante o "tratamento domiciliar" recomendado pela IA.

- Londres, UK (outubro 2025): Adolescente de 16 anos — apendicite diagnosticada como cólica menstrual. Ruptura do apêndice e peritonite. Sobreviveu após cirurgia de emergência.

- São Paulo, Brasil (dezembro 2025): Mulher de 28 anos — meningite diagnosticada como gripe. Hospitalização em UTI por 12 dias.

Viés Algorítmico: A Discriminação Codificada

Quando a IA Não Te Vê

Um dos problemas mais insidiosos dos chatbots médicos é o viés algorítmico — a tendência dos modelos de IA de apresentar desempenho desigual para diferentes grupos demográficos. Esse viés não é acidental: é resultado direto dos dados nos quais os modelos foram treinados.

A maioria dos LLMs foi treinada predominantemente com dados médicos da população branca, masculina, de países desenvolvidos. Isso significa que a IA pode:

- Subestimar dor em pacientes negros: Estudos demonstraram que modelos de IA reproduzem o viés histórico da medicina ocidental de subdiagnosticar dor em pacientes negros

- Ignorar apresentações atípicas em mulheres: Infartos em mulheres frequentemente se apresentam com sintomas diferentes dos "clássicos" descritos em textos médicos. A IA, treinada nesses textos, pode não reconhecer esses padrões

- Falhar em contextos de saúde de países em desenvolvimento: Doenças tropicais, desnutrição, e condições prevalentes em populações de baixa renda são sub-representadas nos dados de treinamento

Privacidade e Segurança de Dados: O Custo Oculto

Seus Dados Médicos Não São Seus

Quando você conversa com um chatbot de IA sobre seus sintomas, você está compartilhando algumas das informações mais sensíveis e íntimas possíveis: condições médicas, histórico familiar, medicamentos, saúde mental, vida sexual, consumo de substâncias. Essas informações são extraordinariamente valiosas — e extraordinariamente vulneráveis.

A maioria dos chatbots médicos opera em zonas cinzentas regulatórias. Diferentemente de hospitais e clínicas, que são obrigados a seguir regulações rigorosas de proteção de dados de saúde (HIPAA nos EUA, LGPD no Brasil, GDPR na Europa), muitos aplicativos de IA se classificam como "ferramentas de bem-estar" ou "informação geral" para evitar essas regulações.

Na prática, isso significa que aquela conversa detalhada sobre seus sintomas de depressão, sua preocupação com uma possível DST, ou seu histórico de câncer na família pode ser armazenada indefinidamente em servidores cujas práticas de segurança são desconhecidas, usada para treinar futuras versões do modelo de IA, vendida a corretores de dados, anunciantes ou seguradoras, e acessada por hackers em caso de vazamento.

O Papel (Ausente) da Regulação

A Regulação Não Acompanha a Tecnologia

O cenário regulatório para chatbots de IA médica em 2026 é fragmentado, confuso e perigosamente inadequado:

EUA (FDA): A FDA emitiu diretrizes preliminares para "Software as a Medical Device" (SaMD) em 2023, mas essas diretrizes foram projetadas para dispositivos médicos tradicionais — não para LLMs generativos que mudam de comportamento a cada atualização. Em 2025, a FDA reconheceu publicamente que sua framework regulatória era "insuficiente para abordar os riscos únicos da IA generativa na saúde."

União Europeia (EU AI Act): O AI Act europeu, que entrou em vigor parcialmente em 2025, classifica aplicações de IA na saúde como "alto risco", exigindo avaliações de conformidade rigorosas. No entanto, a implementação prática é lenta, e muitos aplicativos operam na Europa sem cumprir os requisitos.

Brasil (ANVISA): A ANVISA publicou guias para software como dispositivo médico, mas a fiscalização é limitada. Chatbots de IA operando em português brasileiro estão amplamente disponíveis sem qualquer certificação ou validação clínica.

O Que Deveria Existir

Especialistas em ética médica e tecnologia convergem em recomendações para um framework regulatório adequado:

- Validação clínica obrigatória: Todo chatbot de IA que forneça informação médica deveria passar por ensaios clínicos formais, similarmente a medicamentos e dispositivos médicos

- Transparência algorítmica: Usuários devem saber que estão interagindo com IA, quais são suas limitações conhecidas, e qual é sua taxa de erro documentada

- Disclaimers obrigatórios: Todo chatbot médico deveria exibir avisos claros de que não substitui profissionais de saúde

- Proteção de dados reforçada: Dados de saúde coletados por chatbots devem ser classificados como dados sensíveis sob as mais rigorosas proteções

- Responsabilidade civil clara: Deve haver responsabilidade legal definida quando diagnósticos incorretos de IA causam danos

- Auditoria de viés: Chatbots médicos devem ser auditados regularmente quanto a viés racial, de gênero, e socioeconômico

O Lado Positivo: Quando a IA Realmente Ajuda

Apesar dos perigos, seria intelectualmente desonesto não reconhecer que a IA tem potencial transformador na medicina — quando usada corretamente, como ferramenta complementar sob supervisão profissional:

- Triagem em emergências: Algoritmos de IA ajudam profissionais a priorizar pacientes em emergências superlotadas

- Detecção de doenças raras: A IA pode cruzar milhares de sintomas e identificar padrões que um clínico geral poderia não reconhecer, encaminhando para especialistas

- Dermatologia e radiologia: Modelos de visão computacional demonstram precisão comparável ou superior à de especialistas humanos na detecção de melanoma e na leitura de radiografias

- Saúde mental: Chatbots de apoio emocional como Woebot e Wysa demonstram eficácia em reduzir sintomas de ansiedade e depressão leve — quando usados como complemento, não substituto, de terapia

O problema não é a IA em si. É o uso da IA sem supervisão, sem validação, sem regulação, e sem transparência sobre suas limitações.

Recomendações Práticas Para Você

Como Usar IA Médica Com Segurança

- Nunca use chatbots como substituto de médicos para sintomas novos, persistentes, ou graves

- Verifique QUALQUER diagnóstico de IA com um profissional de saúde humano

- Desconfie de diagnósticos tranquilizadores — a IA tende a subestimar gravidade

- Não compartilhe informações identificáveis (nome completo, CPF, número de convênio)

- Prefira chatbots com validação clínica documentada e aprovação regulatória

- Se em dúvida, procure emergência — nenhum chatbot substitui um exame físico

Conclusão: A Responsabilidade é de Todos

A proliferação de chatbots médicos de IA é um fenômeno que não vai retroceder — a conveniência e o custo são vantagens poderosas demais. Mas a questão que a sociedade precisa responder com urgência é: estamos dispostos a aceitar que centenas de milhões de pessoas tomem decisões de saúde potencialmente fatais baseadas em algoritmos que nunca foram validados clinicamente, que operam sem supervisão regulatória, e que tratam dados médicos sensíveis com menos proteção do que dados bancários?

A resposta deveria ser um "não" inequívoco e ensurdecedor. A regulação precisa acompanhar a inovação — não para impedi-la, mas para garantir que a promessa da IA na saúde não se transforme em uma epidemia de negligência algorítmica. Até que isso aconteça, a responsabilidade recai sobre cada indivíduo: use a IA como ferramenta, nunca como médico.