Chatbots de IA en Medicina: Cuando Confiar Tu Salud a un Algoritmo Puede Ser Fatal

Fecha: 13 de marzo de 2026

Tiempo de lectura: 26 minutos

Emoji: 🤖

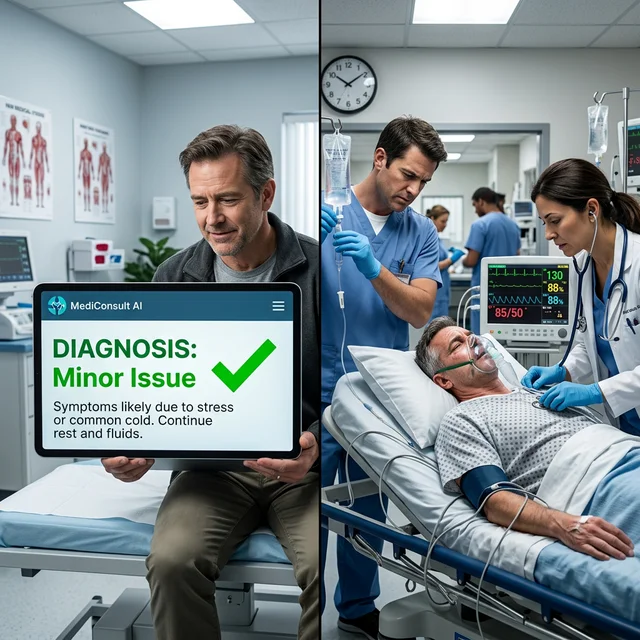

En enero de 2026, una mujer de 34 años en Ohio, Estados Unidos, murió tras seguir las recomendaciones de un chatbot de inteligencia artificial para tratar lo que ella creía era una migraña persistente. El chatbot — uno de los muchos aplicativos de "consulta médica por IA" disponibles gratuitamente — diagnosticó sus síntomas como "cefalea tensional" y recomendó reposo y analgésicos comunes. En realidad, ella sufría de un aneurisma cerebral no diagnosticado que se rompió 48 horas después. La familia procesó a la empresa desarrolladora por negligencia y homicidio culposo. Este caso trágico, lejos de ser aislado, expone una epidemia silenciosa: cientos de millones de personas están sustituyendo consultas médicas reales por interacciones con algoritmos entrenados en datos incompletos, sesgados y frecuentemente desactualizados.

El Boom de los Chatbots Médicos: Números Que Asustan

Una Revolución Sin Supervisión

El mercado de chatbots médicos basados en IA explotó tras el lanzamiento de ChatGPT en noviembre de 2022. En 2026, el paisaje está dominado por una proliferación de aplicaciones que prometen "diagnósticos instantáneos" y "consultoría de salud 24/7". Los números son impresionantes y preocupantes:

| Dato | Valor |

|---|---|

| Usuarios globales de chatbots médicos de IA (2026) | ~450 millones |

| Consultas diarias estimadas | ~15 millones |

| Mercado global proyectado (2027) | $1,2 mil millones |

| Apps de diagnóstico por IA disponibles | ~2.800 |

| Porcentaje con aprobación regulatoria (FDA/EMA) | <3% |

| Tasa de error en diagnósticos complejos | 30-50% |

| Usuarios que usan IA como SUSTITUTO del médico | ~38% |

El dato más alarmante: casi 4 de cada 10 usuarios utilizan chatbots de IA como sustitutos completos del médico. En economías en desarrollo, donde el acceso es limitado y costoso, esta proporción supera el 60%.

¿Por Qué la Gente Confía en la IA Para la Salud?

- Costo: Una consulta médica en EE.UU. cuesta en promedio $250-400 sin seguro. Un chatbot de IA es gratuito o cuesta $10-20/mes.

- Accesibilidad: Los chatbots están disponibles 24/7, en cualquier idioma, sin desplazamientos ni salas de espera.

- Vergüenza y estigma: Muchas personas prefieren "preguntar a la IA" sobre condiciones socialmente estigmatizadas.

- Ilusión de competencia: Los LLMs articulan información médica con fluidez y confianza que crea una ilusión peligrosa de competencia clínica.

Los Peligros Documentados: Cuando la IA Falla Fatalmente

Diagnósticos Incorrectos: La Amenaza Más Directa

Estudio de Harvard Medical School (2025): 400 escenarios clínicos sometidos a 8 chatbots. Diagnóstico principal correcto: 52-74%. Diagnóstico correcto en emergencias críticas: 38-65%. "Alucinaciones médicas" detectadas en 12-26% de las respuestas.

Estudio BMJ Digital Health (enero 2026): 1.200 interacciones reales en 6 países. En el 23% de los casos graves, el chatbot recomendó "monitorear en casa". En el 15%, sugirió medicamentos con interacciones peligrosas. En el 8%, confundió condiciones potencialmente mortales con benignas.

Casos Documentados de Daño

Al menos 12 muertes y cientos de hospitalizaciones fueron atribuidas a diagnósticos incorrectos de chatbots hasta marzo de 2026:

- Ohio, EE.UU. (enero 2026): Mujer de 34 años — aneurisma cerebral diagnosticado como cefalea tensional. Muerte por ruptura 48h después.

- Mumbai, India (noviembre 2025): Hombre de 52 años — infarto diagnosticado como reflujo gastroesofágico. Muerte durante "tratamiento domiciliario".

- Londres, UK (octubre 2025): Adolescente de 16 años — apendicitis diagnosticada como cólicos menstruales. Ruptura del apéndice y peritonitis.

- São Paulo, Brasil (diciembre 2025): Mujer de 28 años — meningitis diagnosticada como gripe. Hospitalización en UCI por 12 días.

Sesgo Algorítmico: La Discriminación Codificada

Cuando la IA No Te Ve

La mayoría de los LLMs fueron entrenados predominantemente con datos médicos de población blanca, masculina, de países desarrollados. Esto significa que la IA puede:

- Subestimar dolor en pacientes negros: Los modelos reproducen sesgos históricos de la medicina occidental

- Ignorar presentaciones atípicas en mujeres: Los infartos en mujeres frecuentemente se presentan con síntomas diferentes de los "clásicos"

- Fallar en contextos de países en desarrollo: Enfermedades tropicales y condiciones de poblaciones de bajos ingresos están subrepresentadas en los datos de entrenamiento

Privacidad y Seguridad de Datos: El Costo Oculto

Tus Datos Médicos No Son Tuyos

Cuando conversas con un chatbot sobre tus síntomas, compartes información extremadamente sensible. La mayoría de los chatbots médicos opera en zonas grises regulatorias, clasificándose como "herramientas de bienestar" para evitar regulaciones de datos de salud como HIPAA, LGPD y GDPR. Esto significa que tus conversaciones detalladas sobre síntomas de depresión, preocupaciones sobre ETS, o historial familiar de cáncer pueden ser almacenadas indefinidamente, usadas para entrenar IA, vendidas a intermediarios de datos, o accedidas por hackers.

El Papel (Ausente) de la Regulación

EE.UU. (FDA): Directrices preliminares insuficientes para IA generativa. UE (AI Act): Clasifica IA de salud como "alto riesgo" pero la implementación es lenta. Brasil (ANVISA): Guías publicadas pero fiscalización limitada.

Lo Que Debería Existir

Expertos convergen en recomendaciones: validación clínica obligatoria, transparencia algorítmica, disclaimers obligatorios, protección de datos reforzada, responsabilidad civil clara, y auditoría de sesgo regular.

El Lado Positivo: Cuando la IA Realmente Ayuda

A pesar de los peligros, la IA tiene potencial transformador cuando se usa correctamente bajo supervisión profesional: triaje en emergencias, detección de enfermedades raras, dermatología y radiología asistida, y apoyo en salud mental como complemento de terapia.

El problema no es la IA en sí. Es la IA sin supervisión, sin validación, sin regulación y sin transparencia sobre sus limitaciones.

Recomendaciones Prácticas

- Nunca uses chatbots como sustituto de médicos para síntomas nuevos, persistentes o graves

- Verifica CUALQUIER diagnóstico de IA con un profesional de salud humano

- Desconfía de diagnósticos tranquilizadores — la IA tiende a subestimar la gravedad

- No compartas información identificable

- Prefiere chatbots con validación clínica documentada

- En caso de duda, busca emergencia — ningún chatbot sustituye un examen físico

Conclusión: La Responsabilidad Es de Todos

La proliferación de chatbots médicos de IA no retrocederá. Pero la sociedad necesita responder con urgencia: ¿estamos dispuestos a aceptar que cientos de millones tomen decisiones de salud potencialmente fatales basándose en algoritmos no validados clínicamente? La respuesta debería ser un "no" inequívoco. Usa la IA como herramienta, nunca como médico.